La era digital ha traído consigo una nueva forma de manipulación de la realidad: los deepfakes. Esta tecnología, que utiliza inteligencia artificial para crear videos y audios falsos de personas reales, plantea un desafío sin precedentes para nuestra capacidad de distinguir entre lo verdadero y lo falso. En este artículo, exploraremos qué son los deepfakes, cómo funcionan, sus implicaciones y cómo podemos protegernos de sus efectos.

¿Alguna vez has visto un video que te dejó atónito? ¿Un político diciendo algo completamente fuera de lugar o una celebridad haciendo algo impensable? Puede que lo que hayas visto no fuera real, sino un deepfake. Esta tecnología, capaz de crear videos tan realistas que es difícil distinguirlos de la realidad, está cambiando la forma en que consumimos información. Adéntrate con nosotros en el mundo de los deepfakes y descubre cómo esta poderosa herramienta está redefiniendo la verdad.»

Contenido del Artículo

¿Qué es un Deepfake?

La desinformación se ha convertido en una epidemia en la era digital. Con la llegada de los deepfakes, esta amenaza se ha intensificado. Estos videos falsos, creados con inteligencia artificial, pueden sembrar la discordia, manipular elecciones y dañar la reputación de personas inocentes. Es hora de entender cómo funcionan estos engaños y cómo podemos protegernos de sus peligrosos efectos.

Deepfake es un término que combina «deep learning» (aprendizaje profundo) y «fake» (falso). Se refiere a contenido multimedia (vídeos, audios o imágenes) que ha sido manipulado digitalmente utilizando inteligencia artificial para hacer que una persona parezca decir o hacer algo que en realidad nunca hizo.

La falsificación de imágenes y videos no es algo nuevo. Sin embargo, la llegada de la inteligencia artificial ha llevado esta práctica a un nivel completamente nuevo. Los deepfakes, capaces de crear videos tan realistas que incluso los expertos pueden ser engañados, representan una amenaza sin precedentes para nuestra sociedad. En este artículo, haremos un recorrido por la historia de la manipulación de imágenes y exploraremos cómo los deepfakes están redefiniendo los límites de lo posible.»

¿Cómo funcionan los deepfakes?

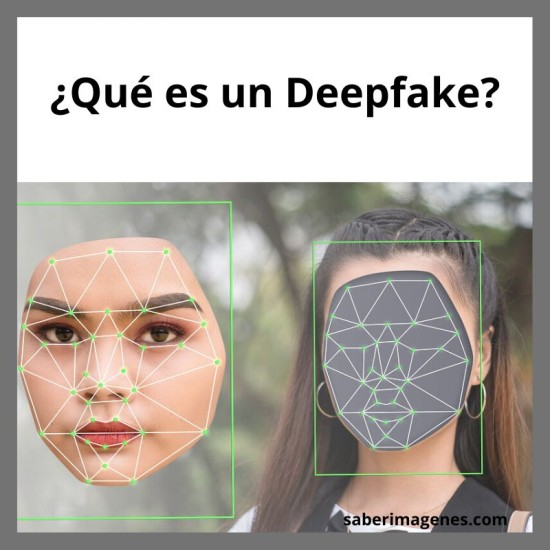

La tecnología detrás de los deepfakes se basa en redes neuronales artificiales, una rama del aprendizaje profundo. Estas redes son entrenadas con grandes cantidades de datos (como fotos, videos o audios) de una persona específica para aprender a imitar su apariencia y voz. Una vez entrenada, la red puede generar contenido nuevo que es prácticamente indistinguible del original.

El proceso generalmente involucra:

- Recopilación de datos: Se reúnen muchas imágenes o videos de la persona que se quiere manipular.

- Entrenamiento de la red neuronal: La red aprende a reconocer los patrones faciales, expresiones y características de voz de la persona.

- Generación de contenido falso: La red crea nuevo contenido, como un video, donde la persona parece hacer o decir algo que nunca hizo.

Ejemplos de Deepfakes

Los deepfakes pueden utilizarse para crear todo tipo de contenido falso, desde videos políticos hasta pornografía no consensuada. Algunos ejemplos comunes incluyen:

- Videos políticos: Se pueden crear videos falsos de políticos diciendo cosas que nunca dijeron, con el objetivo de manipular la opinión pública.

- Pornografía no consensuada: Se pueden crear videos pornográficos falsos con rostros de celebridades o personas conocidas sin su consentimiento.

- Noticias falsas: Se pueden crear noticias falsas utilizando videos deepfake para hacer parecer que alguien dijo algo que no dijo.

Riesgos de los Deepfakes

La proliferación de los deepfakes plantea una serie de riesgos importantes, entre ellos:

- Desinformación y manipulación: Los deepfakes pueden utilizarse para difundir información falsa y manipular a la opinión pública.

- Daño a la reputación: Las personas pueden ser víctimas de deepfakes que dañen su reputación o carrera.

- Cuestionamiento de la realidad: La dificultad para distinguir entre lo real y lo falso puede erosionar la confianza en las instituciones y en la información en general.

Cómo protegerse de los deepfakes?

Si bien es difícil detectar todos los deepfakes, algunas medidas pueden ayudar a reducir el riesgo:

- Verificar la fuente: Antes de compartir o creer en un video, verifica la fuente y busca información adicional.

- Ser crítico: No te fíes de todo lo que ves en internet.

Buscar señales de manipulación: Presta atención a detalles como la calidad del video, las expresiones faciales y los movimientos de los labios. - Utilizar herramientas de detección: Existen algunas herramientas que pueden ayudar a identificar deepfakes, aunque no son infalibles.

Los deepfakes son una tecnología poderosa que plantea desafíos importantes para la sociedad. Es crucial ser conscientes de esta amenaza y tomar medidas para protegernos de la desinformación y la manipulación.

¿Cómo evolucionará la tecnología de deepfake en el futuro?

La tecnología de deepfake está evolucionando a un ritmo vertiginoso y se espera que su impacto sea cada vez mayor en diversos aspectos de nuestra vida. Aquí te presento algunas de las tendencias que podrían marcar el futuro de los deepfakes:

Mayor realismo y sofisticación

- Mayor resolución y calidad: Los deepfakes se volverán cada vez más realistas, con una resolución y calidad de imagen y audio que dificultará aún más su detección.

- Ampliación de las posibilidades: Se podrán manipular no solo rostros, sino también cuerpos completos, expresiones faciales más sutiles y hasta voces con mayor precisión.

- Generación de contenido más diverso: Los deepfakes podrán crear contenido más variado, como animaciones, efectos especiales y simulaciones de entornos virtuales.

Mayor accesibilidad

- Democratización de la tecnología: Las herramientas para crear deepfakes se volverán más accesibles y fáciles de usar, lo que podría aumentar el número de personas capaces de generar este tipo de contenido.

- Reducción de costos: El costo de crear deepfakes disminuirá, lo que facilitará su producción a gran escala.

Nuevos usos y aplicaciones

- Entretenimiento: Los deepfakes se utilizarán cada vez más en la industria del entretenimiento, para crear efectos especiales, revivir a actores fallecidos o generar nuevos personajes.

- Educación: Los deepfakes podrían utilizarse para crear simulaciones realistas de situaciones de aprendizaje, como prácticas médicas o simulaciones históricas.

- Comercio: Las empresas podrían utilizar deepfakes para personalizar la publicidad y mejorar la experiencia del cliente.

Desafíos y riesgos

- Desinformación y manipulación: El aumento de la sofisticación de los deepfakes hará que sea aún más difícil distinguir entre lo real y lo falso, lo que podría tener graves consecuencias para la democracia y la sociedad en general.

- Privacidad: La creación de deepfakes sin consentimiento plantea serias preocupaciones sobre la privacidad y la seguridad de las personas.

- Ética: El uso de deepfakes para fines maliciosos, como la extorsión o la difamación, plantea importantes dilemas éticos.

¿Qué podemos hacer?

Para hacer frente a estos desafíos, es necesario:

- Desarrollar mejores herramientas de detección: Se necesitan herramientas más sofisticadas para identificar los deepfakes y distinguirlos del contenido auténtico.

- Promover la alfabetización digital: Es fundamental educar a la población sobre cómo identificar los deepfakes y evaluar la credibilidad de la información en línea.

- Regular el uso de los deepfakes: Se requieren regulaciones claras y efectivas para limitar el uso malicioso de los deepfakes y proteger los derechos de las personas.

- Fomentar el desarrollo de tecnologías éticas: Es necesario invertir en el desarrollo de tecnologías de inteligencia artificial que sean éticas y responsables.

En resumen, el futuro de los deepfakes es incierto y plantea importantes desafíos. Sin embargo, también ofrece oportunidades para innovar y mejorar nuestra sociedad. Es fundamental que trabajemos juntos para encontrar soluciones que permitan aprovechar los beneficios de esta tecnología al tiempo que mitigamos sus riesgos.